CCTV 환경에서의 프라이버시 제공 최신 기술들 소개

1. e-JIKEI 카메라 기반 e-JIKEI 네트워크 프라이버시 제공 기법

2. Dairi EYE Lock 프로그램 기반 프라이버시 제공 기법

3. 세미블라인드 핑거프린팅(Semi-blind Fingerprinting) 기반 프라이버시 제공 기법

4. Privacy-Safe See-Through Vision 기반 프라이버시 제공 기법

5. USB 메모리 기반 영상 감시 카메라 시스템 프라이버시 제공 기법

6. 적응적 비쥬얼 개념을 활용한 PriSurv 기반 프라이버시 제공 기법

7. 프라이버시 보호를 제공하는 영상 감시 카메라 이미지 분배 시스템 기법

8. 프라이버시 보호를 위한 H.264/AVC 영상 스크램블링 기법

9. SecST-SPIHT 코딩 및 디코딩 스킴을 적용한 프라이버시 제공 기법

10. 영상 감시 시스템 내의 민감한 프라이버시 정보에 대한 영상 데이터 은닉 기법

11. RFID 기반의 프라이버시 제공 영상 감시 시스템 기법

12. Scalable Video Coding을 이용한 프라이버시 보호 영상 감시 시스템 기법

13. DRM 기반의 프라이버시 제공 영상 감시 시스템 기법

14. 영상 감시 시스템 내의 프라이버시 보호를 위한 주파수 영역 기반 스크램블링 기법

15. 보안 카메라 내의 움직이는 객체 마스킹을 통한 프라이버시 보호 기법

16. 얼굴 검출 및 JPEG2000의 ROI 코딩 기반 프라이버시 제공 영상 감시 시스템 기법

17. Life-log 시스템 영상을 위한 프라이버시 보호 기법

18. 자동화된 영상 감시 시스템을 위한 보안과 프라이버시 보호 기법

19. 접근레벨 기반의 CCTV 영상 프라이버시 보호 기법

20. SPDCM(Stated Preference Discrete Choice Modelling) 기반 프라이버시 보호 기법

21. DWDM 파장 개선을 활용한 CCTV 보안 시스템 기법

22. 구글 스트리트 뷰 서비상에서의 얼굴 블러닝(Face-blurring) 기법

본 기고에서는 Yabuta 등에 의해 연구된 CCTV 환경에서 영상 내의 다양한 객체들에 대한 프라이버시를 제공하는 방법으로 응용 가능한 보안 카메라 내의 움직이는 객체 마스킹을 통한 프라이버시 보호 기법에 관해 소개한다.

제안된 기법의 장점들?

CCTV 카메라 설치의 증가로 인해 녹화된 영상 내의 객체들(objects)에 대한 프라이버시 보호(privacy protection)는 CCTV 시스템에서 아주 중요한 보안 이슈가 되고 있다. Yabuta 등은 이러한 프라이버시 침해 문제 해결을 위해 보안 모니터링(security monitoring)과 프라이버시 보호를 위한 영상 처리와 데이터 은닉(data hiding)을 위한 보안 프레임워크(framework)를 제안하였다. Yabuta 등이 제안한 영상감시 시스템 내의 프라이버시 보호를 위한 보안 카메라 내의 움직이는 객체 마스킹을 통한 프라이버시 보호 기법은 다음과 같은 장점들을 가진다.

(1) 녹화된 영상에서 프라이버시 보호가 필요한 객체들은 적절한 영상 처리 과정에 의해 의미 없는 영상으로 변경된다. 이로 인해, 해당 객체들이 영상 내에서 올바르게 인식할 수 없게 되기 때문에 이들 객체들을 전혀 식별할 수 없게 된다.

(2) 원래의 객체들(original objects)은 JPEG 표준을 사용한 엔코딩 알고리즘을 기반으로 암호화된 후 출력 영상 내에 워터마킹된다. 원 영상은 관리자와 같은 특별한 사용자(special viewer)에 의해서만 보여지게 된다. 다시 말해 올바른 패스워드(password)를 소지한 권한이 있는 사용자는 비트 스트림(bitstream) 단위로 내포되어 있는 움직이는 객체를 언제든지 복호화(decrypt) 할 수 있다.

(3) 녹화된 객체들의 프라이버시 보호 과정을 실시간 처리(real-time processing) 할 수 있다. 실험결과로써 신호 대 잡음비(peak signalto-noise ratio, PSNR), 압축률(compression rate), 임베딩 할 수 있는 객체의 최대 크기 등에 관한 실험 성능이 우수하다.

프라이버시 보호를 위한 보안 모니터링 시스템?

[그림1] 프라이버시 보호의 정의

Yabuta 등은 녹화된 객체들에서 누가 사람이고 차량 번호가 무엇인지 등과 같은 존재여부를 모니터링 된 영상 내에서 감지할 수 없도록 하는 프라이버시 보호에 관한 정의를 [그림 1]과 같이 정의하였다.

프라이버시가 보호된 영상(privacy-protected image)으로부터 누가 거기에 있는지를 볼 수 없다. 하지만 어떤 일이 일어나고 있는지는 알 수 있다. 따라서 의미 없는 객체로 변형된 프라이버시가 보호된 영상은 객체의 프라이버시를 보호할 뿐만 아니라 영상 감시 기능도 제공할 수 있다. 다시 말해, 의미 없이 변형된 객체는 누가 거기에 있고 무슨 일이 일어나는지 여부를 전혀 알 수 없게 됨으로 객체에 대한 프라이버시를 보호할 수 있다.

프라이버시가 보호된 영상은 JPEG 표준을 사용하여 압축된다. 이로 인해 원 영상 뷰어를 사용할 수 있는 권한이 있는 사람만 영상을 볼 수 있다. 제안하는 보안 카메라 시스템에서 프라이버시 보호를 위한 요구사항들은 다음과 같다.

(1) 녹화된 영상 내의 이동 객체들은 마스킹 기술과 같은 왜곡 기술들을 통해 식별할 수 없는 형태로 변경되어야 한다.

(2) 엔코더(encoder)는 하나의 프레임 데이터가 입력될 때 오직 하나의 JPEG 비트스트림만을 생성하여야 한다. 통상적인 권한이 있는 뷰어(viewer)만이 마스킹 된 영상을 디코드(deco de)하여 원래의 영상으로 복원할 수 있어야 한다.

(3) 마스킹 된 영상들은 해당 영상을 보기 원하는 모든 사람들을 위해 JPEG 뷰어로만 볼 수 있도록 해야 한다.

(4) 원 영상들은 디코딩 패스워드를 가진 특별한 뷰어에 의해서만 복원이 되어야 한다.

(5) 복원 권한이 있는 뷰어는 마스킹 된 객체들 중 프라이버시 제거가 필요한 객체만 선택적으로 복원하여 나머지 객체에 대해서는 여전히 프라이버시를 제공할 수 있어야 한다.

(6) 엔코딩(encoding)은 실시간으로 처리되어야 한다.

구현?

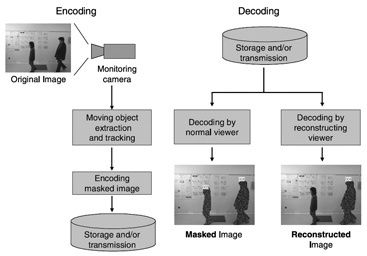

[그림2] 보안 카메라 시스템의 처리 흐름

[그림 2]는 보안 카메라 내의 움직이는 객체 마스킹을 통한 프라이버시 보호 기법의 구현 결과를 보여주고 있다. 먼저 이동 객체들은 원 입력 영상으로부터 추출된 후 유일한 객체 식별 번호(unique object identification number)를 개별 이동 객체에 할당한다. 다음으로, 추출된 객체들 및 이들과 연관된 객체 번호들과 함께 입력 영상을 엔코더(encoder)에게 전송한다. 그러면, 엔코더는 마스킹 된 영상의 JPEG 비트스트림을 생성한 후 이전에 추출된 객체들에 각각 워터마킹 비트 값을 삽입한다.

이동 객체 추출 및 트랙킹(Moving Object Extraction and Tracking) 단계: 먼저 배경 추출 방법(background subtraction methods)을 사용하여 이동 객체들을 추출한다. 이후 노이즈(noise) 최소화 및 그림자 감지와 같은 과정들을 수행하여 실제 움직이는 동적 객체들을 추출한다. 추출된 이동 객체들은 일반적인 트래킹 방법을 이용하여 입력 영상의 시간 순서에 따라 추적 분류한다. 이때 동일한 객체들인 경우 동일한 식별 번호를 부여한다. 이후의 프레임에서 또 다른 이동 객체가 감지되면 새로운 객체 번호를 부여한다.

[그림3] 제안된 엔코더(encoder)의 구조

마스킹 된 영상의 엔코딩(Encoding Masked Image) 단계: [그림 3]은 제안된 엔코더의 구조를 보여준다. 원 영상, 추출된 이동 객체 영상들, 그리고 객체 번호들이 엔코더에 입력된다. 먼저 추출된 이동 객체 영상들은 JPEG 표준에 정의된 방법들인 DCT(discrete cosine transform), 양자화(quantization), 지그-재그 스캔(zig-zag scan), run-length 기술과 허프만 코딩(Huffman coding) 과정을 통해 엔코딩된다. 이때 하나의 비트스트림은 하나의 객체 영상으로부터 생성된다. 만약 원 영상인 여러 개의 객체들을 포함하고 있으면 각 객체 영상은 허프만 코딩된 비트스트림으로 각각 변형된다. 이후 각각의 비트스트림은 암호화 키(encryption key) 기반의 AES(advanced encryption standard) 대칭키 암호시스템을 사용하여 각각 암호화된다. 사용된 암호화 키는 시스템 관리자가 제공한 패스워드와 이에 대응되는 객체 번호를 이용하여 생성된다.

AES에 의해 암호화된 하나 또는 다수개의 객체 데이터는 하나의 이진 데이터 스트림으로 통합된다. 그리고 원 영상 내의 이동 객체 영역들은 스크램블링(scrambling), 삭제하기(erasing) 또는 기타 방법을 사용하여 왜곡 변형된다.

[그림4] 마스킹 기법들 비교

[그림 4]는 다양한 마스킹 기법들을 보여주고 있다. 이후 원 영상은 마스킹 된 영상으로 변형되며, 마스킹 된 영상은 DCT와 양자화 과정을 거쳐 엔코딩 된다.

[그림5] 워터마킹 정보를 삽입되는 생성 과정

[그림6] 워터마킹을 위한 DCT계수들의 위치

[그림 5]의 과정을 거친 암호화된 객체 데이터는 [그림 6]에서 보여주는 것과 같이 양자화된 DCT 계수들(coeffi cients) 내에 워터마킹 된다. 그리고나서, 이들 계수들은 허프만 코딩에 의해 다시 엔코딩 된다. 최종적으로 엔코더는 입력 영상에 대한 하나의 JPEG 비트스트림을 출력한다.

디코딩(Decoding) 단계: 복원 권한이 있는 뷰어는 원 이동 객체를 볼 수 있다. 즉 올바른 패스워드를 소유한 복원 권한이 있는 뷰어는 암호화되고 엔코더에 의해 임베딩 된 이동 객체를 원래대로 복원할 수 있다.

[그림7] 복원 뷰어의 구조

[그림 8] 원하는 객체에 대한 복호화 과정

[그림 9] 원 영상, 마스킹 된 영상, 복원된 영상들(a)원 영상,(b)스크램블링에 의해 마스킹 된 영상,(c) 삭제하기에 의한 마스킹 된 영상,(d)(b)의 객체 6이 복원된 영상, (e)(c)의 객체 4가 복원된 영상.

[그림 10] 움직이는 객체인 자동차에 실험한 결과

[그림 7]은 이러한 복원 과정을 보여 주고 있다. 원 영상에서 비트스트림을 디코딩 하기 위해서는 임베딩 된 객체 데이터를 추출하여야 한다. 이를 위해 먼저 비트스트림은 JPEG 디코딩 방법과 같이 허프만 디코딩을 사용하여 양자화된 DCT 계수들을 디코딩한다. 이들 양자화된 DCT 계수들은 객체 데이터를 포함하고 있다. 객체 데이터를 추출한 후, 양자화된 DCT 계수들은 역양자화와 역DCT 과정을 거쳐 변환되어 마스킹된 영상이 최종적으로 디코딩된다. 이렇게 추출된 객체 데이터는 이후의 복호화(decryption) 단계로 보내지게 된다. 다수 개의 객체들이 존재할 때, 모든 객체들의 데이터는 [그림 8]의 복호화 과정을 거쳐 추출된 객체 데이터를 포함한 원하는 객체로 디코딩 된다. 이때 복호화 키와 객체 번호 k만을 적용하면 객체 데이터 k만을 복호화 할 수 있음으로 원하는 객체에 대해서만 프라이버시를 제거 할 수 있다.

시뮬레이션 결과?

본 실험에서는 [그림 9]와 같이 각 픽셀 당 24비트로 구성된 320*240 픽셀의 영상을 활용하였다. [그림 9]의 (a)는 원 영상(original image)을 보여주며 (b)-(e)는 스크램블링 된(scrambled) 영상, 삭제된(erased) 영상, 복원된(reconstructed) 영상들을 각각 보여주고 있다. [그림 10]은 [그림 9]와 유사한 방법을 움직이는 객체인 자동차(car)에 적용한 실험결과를 보여주고 있다.

<다음호에서는 영상 감시 시스템 내의 프라이버시 보호를 위한 얼굴검출 및 JPEG2000의 ROI 코딩 기반 프라이버시 제공 영상 감시 시스템 기법에 관해 살펴보도록 하겠다.>

[참고문헌]

[1] [1] Kenichi YABUTA 등. "Privacy Protection by Masking Moving Objects for Security Cameras", IIEICE Transactions on Fundamentals of Electronics, Communications and Computer Sciences, Volume E92.A, Issue 3, pp. 919-927 (2009).

저작권자 © CCTV뉴스 무단전재 및 재배포 금지